Elon Musk y Bill Gates bregan por el "apagado"

Los debates alrededor de la Inteligencia Artificial: regulación, ¿sí o no?

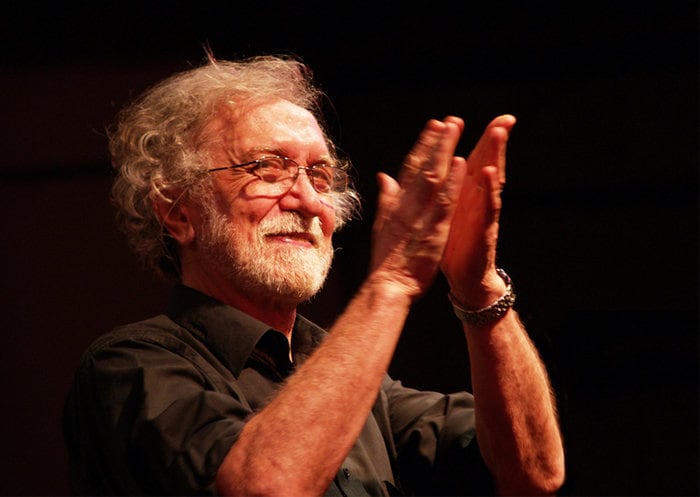

Para el profesor e investigador del Conicet Emmanuel Iarussi, si bien el pedido que hicieron a principios de este año cientos de popes del área para frenar el desarrollo de esta tecnología "pone en agenda" el tema, también "exagera" ciertos peligros o miedos infundados.