¿Hay dudas de que la Inteligencia Artificial (IA) es uno de los temas del año? No. Simplemente porque los hechos nos dan de lleno en la cara. Cuando a principios de diciembre OpenAI lanzó ChatGPT, el modelo de lenguaje impulsado por IA capaz de generar respuestas de texto similares a las de una persona, supimos que aquello sólo podría escalar.

Tomando la definición de la propia compañía de Elon Musk, ChatGPT "puede responder preguntas, conversar sobre una variedad de temas y generar escritos creativos". Esa descripción, nueve meses después, queda cortísima. Hoy les pedís a estos modelos de IA que te generen un texto equis, de tal género y con tal estilo, y te lo devuelven; les hacés preguntas de ciencia, te devuelven; les hacés preguntas existenciales, te devuelven; les pedís que revisen y mejoren un código de programación, te devuelven; les pedís que generen imágenes, y bueno... estamos listes para zarpar.

Una de las señales de que ChatGPT había permeado de modo masivo ocurrió a fines de marzo, cuando el ex presidente Mauricio Macri leyó, en la cena de Fundación Libertad, un discurso que la IA le había generado segundos antes. "No les voy a leer todo porque realmente está muy bueno", dijo y, más allá de esa rara sensación de por qué no compartir algo que está muy bueno, quedó en evidencia, entre sorpresa y vergüenza ajena, que el ChatGPT circulaba por todos lados, y para que todes le echemos mano.

Lo que asomó en paralelo fue la noción de que, para que la inteligencia artificial entregara un resultado contundente, había que escribir la petición (el prompt) del modo más preciso posible. Desde entonces, la formulación de prompts se alzó como LA condición para conseguir los mejores resultados, al punto de que ya se habla de prompt engineering (ingeniería) como carrera de grado y algo de lo que es importante saber.

► Espiando el futurx

Habiendo pasado nueve meses del lanzamiento de ChatGPT, es importante generar espacios de diálogo y reflexión en torno a la aparición de nuevas herramientas, conocer sus posibilidades, así como sus lados flojos, y compartir experiencias y nuevas modos de creación artística.

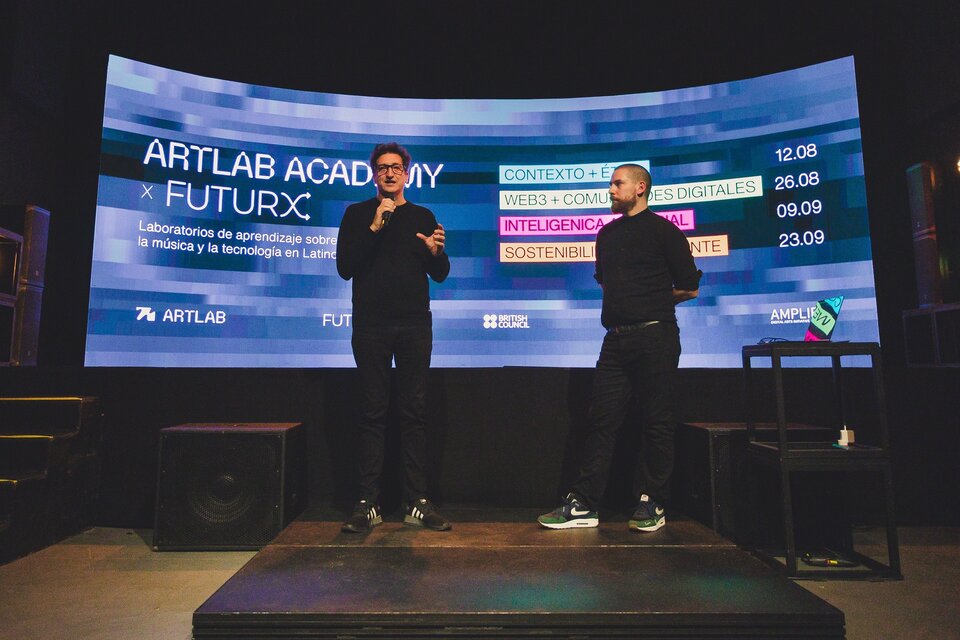

En el ámbito local, la plataforma Futurx (se pronuncia "futurex") busca ampliar el alcance de estas tecnologías con movidas como Artlab Academy, un ciclo de encuentros en Artlab para indagar en cinco ejes conceptuales que hacen foco en las transformaciones que está teniendo la creación musical y las nuevas herramientas: IA, web3, la sostenibilidad, el rol de los creadores hoy y los nuevos modelos de organizaciones.

"La idea es darle un campo tanto de análisis como de discusión a estos temas que muchas veces no tienen un lugar físico para el intercambio", cuenta su director, Nicolás Madoery. El próximo encuentro estará vinculado a los usos de modelos de IA y su empleo para la música. "El abordaje lo enfocamos desde tres lugares. El primero son usos y percepciones generales dentro del ecosistema musical, con una encuesta a más de 150 personas para entender qué es lo que les pasaba, si ya usaban IA, si les interesaba. Otro ítem es lo legal y lo ético, para lo que trabajamos en focus groups con abogados y personas de sellos, para entender su visión alrededor de este tema. Y el último es para modelos de uso", desarrolla Madoery.

En esta próxima sesión se mostrarán los resultados preliminares de la investigación. "Además, va a haber una presentación de Wolfie, que es una IA que ayuda a gestionar proyectos de música, desarrollada por Larrosa Music Group, que es nuestro socio en la confección del reporte." En coproducción con Fundación Williams y Amplify, el programa del British Council que busca visibilizar el trabajo de mujeres y disidencias en la música electrónica, Futurx incursionó en el proyecto de clonación de voz. "En base a diez voces de cantoras latinoamericanas, estábamos generando una clonación de voz de una cantora latinoamericana nueva, única."

Así como ya existen la generación de texto e imagen con IA, también pasa con lo sonoro. El mes pasado, Meta lanzó AudioCraft, su más reciente herramienta de IA "que genera audio y música de alta calidad a partir de texto". Es open-source, lo que significa que su código puede ser modificado por cualquiera, se puede construir a partir de su estructura y utilizarlo para entrenar tus propios sets de datos.

AudioCraft consta de tres modelos: MusicGen, que genera música a partir de indicaciones de texto; AudioGen que genera audio y sonidos puntuales; y EnCodec, que es algo demasiado complejo para este espacio, pero "a sus hijes les encantará", diría Marty McFly. Una manera de probarlo y pasar horas en el navegador es a través de Hugging Face: escribís cómo querés que sea la música y clickeás Generate. Incluso es posible subir tracks de audio para que la IA tome como referencia.

![function body_3(chk,ctx){return chk.f(ctx.getPath(false, ["author","title"]),ctx,"h");}](https://images.pagina12.com.ar/styles/width470/public/2020-09/julio-nusdeo.png?itok=7cyEE71r)